文 | 乌鸦智能说

不少人有这样一个判断:2024会是推理的元年。据英伟达2023年财报电话会议披露,公司全年数据中心里已经有40%的收入来自推理业务,超出了绝大部分人预期。

让人没想到的是,推理端的爆发率先在大模型价格上卷了起来。今年5月,幻方、字节先后发布新模型,价格动辄市面上原有模型的1%。同时,智谱也官宣了新的价格体系,将入门级产品GLM-3 Turbo模型的价格下调了80%。

这样的趋势,同样也在国外发生。自去年以来,OpenAI已经进行了4次降价。在刚刚结束的春季功能更新会上,OpenAI宣布了其最新模型GPT-4o,不仅性能有大幅提升,价格也下调了50%。

那么,驱动这**模型推理成本下降的逻辑是什么?我们又应该如何理解推理成本下降对产业的意义?

降本超预期!GPT4一年降价超80%

从5月召开的发布会来看,各家在大模型价格上卷得越来越厉害了。

5月6日,幻方量化旗下DeepSeek(深度求索)发布第二代MoE模型DeepSeek-V2,该模型API定价为每百万Tokens输入1元、输出2元(32K上下文),价格为GPT-4 Turbo的近百分之一。

5月11日,智谱大模型官宣新的价格体系,新注册用户可以获得额度从500万 tokens 提升至2500万 tokens,并且入门级产品GLM-3 Turbo模型调用价格从5元/百万Tokens降至1元/百万Tokens,降幅高达80%。

5月13日,OpenAI发布GPT-4o,不仅在功能上大幅超越GPT-4 Turbo,价格只有一半。

5月15日,豆包主力模型为0.0008元/千Tokens,即0.8厘就能处理1500多个汉字,宣称比行业便宜了99.3%。在32K(千字节)以下主力模型中,每1000 Tokens(大模型文本中的一个最小单位)的企业市场使用价格,GPT-4(美国AI研究公司OpenAI旗下的大模型)为0.42元,百度文心一言和阿里通义千问为0.12元。

可以看到,大模型降价既有GLM-3 Turbo这样的入门模型,也有像性能接近GPT-4 Turbo的主力模型。而从OpenAI过去一年的动作看,降价也一直其升级的主线。

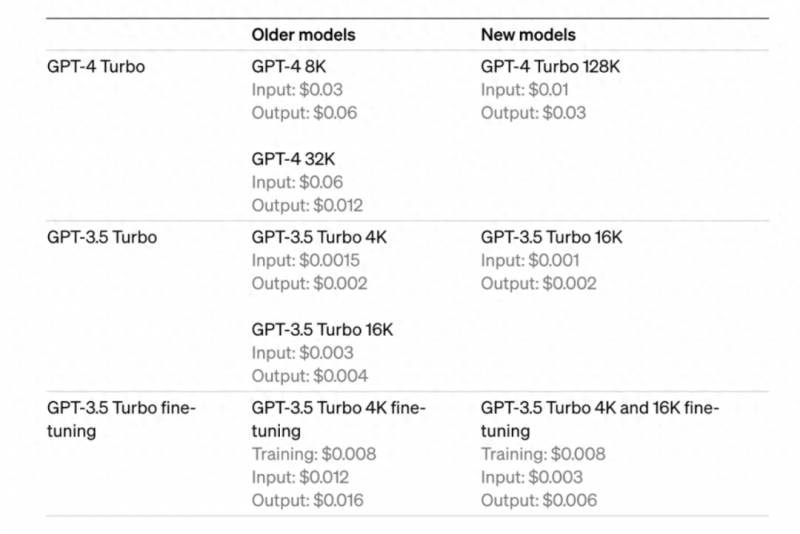

算上此次GPT-4o的发布,2023年年初以来,OpenAI已经进行了4次降价。去年3月,OpenAI开放了gpt-3.5-turbo,每1000个token的成本为0.002美元,价格比此前的GPT-3.5模型下降了90%。

到去年11月,OpenAI发布了GPT-4 Turbo的同时,也对整个平台的价格做出了调整。其中,GPT-4 Turbo输入tokens价格是GPT-4的1/3,为0.01美元/1k tokens(折合人民币约0.07元),输出tokens价格是其1/2,为,折合人民币约0.22元)。

今年1月,OpenAI推出了新版的GPT-3.5-Turbo,型号为gpt-3.5-turbo-0125,gpt-3.5-turbo-0125输入的价格降低了50%,为0.0005美元/1000 tokens,输出价格也降低了25%,为0.0015美元/1000 tokens。

此外,OpenAI还推出饿了两个新一代embedding模型:text-embedding-3-small和text-embedding-3-large。其中,text-embedding-3-small远比OpenAI之前的text-embedding-ada-002模型效率高,因此价格也大幅降低了5倍,从每千token的0.0001美元降至0.00002美元。

从去年3月OpenAI发布GPT4到现在,其产品从GPT4升级到GPT-4o,输入价格从0.03美元/1k tokens下降到0.005美元/1k tokens,降幅为83%;输出价格从0.06美元/1k tokens下降到0.015美元/1k tokens,降幅为75%。

根据此前预期,大模型大致将按照每年50-75%幅度降本,也就是说,现在大模型的降本速度远超预期。

模型优化驱动下的成本下降

过去,大模型推理成本下降,很大程度要依赖于算力的升级。但纵观过去一年,推理成本的下降,是在算力没有升级的情况完成的,包括架构创新、推理优化、系统升级、甚至推理集群计算架构方面等等。

这意味着,除了算力升级外,模型优化本身也有着很大的空间。从目前看,算法框架革新主要有两条思路:轻量化和线性化。

其中,轻量化以Mixtral 8*7B模型为代表,其核心思路是采用混合专家模型MoE,架构中基于多个专家并行机制,推理时只激活部分专家,以稀疏性压缩了参数数量和推理成本。

MoE架构主要由两个关键部分组成:专家网络和门控机制。所谓的“专家网络”,就是传统Tranformer架构的FFN(前馈网络)层是一个完全连接的神经网络,MoE架构的FFN层则划分成稀疏性的神经网络,这些被称之为“专家”的小FFN,每个都有自己的权重和激活函数,它们并行工作、专注于处理特定类型的信息。而门控机制则用来决定每个token被发送到哪个专家网络的调配器。

MoE架构强调“术业有专攻”,把不同的问题交给相应领域的专家来解决,就好比一家公司有多个部门,在做决策的时候,公司的CEO会把具体的问题分配到相关的部门进行讨论,最终产生最优的决策。

与轻量化不同,线性化更注重对信息的压缩。Transformer架构模型在推理时与上下文内容进行逐字对比,而线性化模型对前文信息进行了压缩,实现了复杂度线性化,意味着更快的推理速度和更低的计算成本。

此次DeepSeek-V2的降价,就是其通过架构创新,实现了大模型成本尤其是推理成本下降的结果。具体来说,DeepSeek-V2在注意力机制和稀疏层方面做出了创新性的设计。

一方面,其稀疏MoE架构进行了共享专家等改进,相比V1的稠密模型,节约了42.5%的训练成本。另一方面,DeepSeek-V2也创新性地运用先进的注意力机制MLA,压缩token生成中对key value的缓存,极大降低了推理成本。

长期来看,在算力升级以及架构优化等一系列因素的推动下,模型推理成本下降的速度很有可能超出大家预期,并加速应用层的不断创新和生态繁荣。

一场成本驱动型生产力**

从过去看,科技变革本质上都是伴随着边际成本的大幅下降。根据A16Z的合伙人 的观点,过去几十年人类大致经历了两次大的科技变革,分别是芯片和互联网。

在新一波浪潮里,芯片的诞生,将计算的边际成本降到了趋近为零。在微芯片出现之前,计算是通过手工完成的。人们在大房间里做对数表。然后ENIAC被引入,计算速度提高了四个数量级,然后发生了计算机**。这一时期出现了IBM、惠普等公司。

到了互联网时代,互联网技术将分发的边际成本降到了零。以前无论你发送什么(一个盒子或者一封信)都需要一定的成本,互联网出现后,每bit的价格急剧下降。顺便说一下,这也是四个数量级改进。这引领了互联网**。这一时期出现了亚马逊、谷歌和Meta等公司。

与上述两个技术类似,AI也同样是一场成本驱动型生产力**。大模型则是将创造的边际成本降到了零,比如创建图像和语言理解等等。

举个例子,以前创造一个漫画角色可能需要一个时薪100美元平面设计师,而现在大模型只需要0.01美元,而且只需要一秒钟。再以客服行业为例,目前普遍的AI客服定价都隐含相比人工客服接近1:10的ROI,这意味着过去在美国一位年薪5万刀的客服人员,在应用大模型产品后成本会降低到5000刀。

目前受限于模型推理成本较高,AI应用普遍面临较大的成本压力。

根据无问芯穹发起人汪玉,用公开数据做了一次针对算力成本数量级的测算,假设GPT-4 Turbo每天要为10亿活跃用户提供服务,每年的算力成本可能超过两千亿,这还不包括模型训练的投入。

绝大部分公司的收入仍然还在亿的级别,因此这种成本在打造商业闭环上,显然是不成立的。

从这个角度上说,推理成本下降将成为打开AI应用的重要“开关”。更重要的是,过去的科技发展历史,告诉我们,如果需求具有弹性,那么随着成本下降,使用量也会因为可及性提升而答复增加。

几乎可以肯定的是,互联网大幅带动了全球经济的增长。而人工智能大概率也将经历同样的故事。